麦肯锡:ChatGPT 等生成式 AI 技术将如何改变企业?

生成式人工智能(AI)和其他基础模型正在改变AI的格局,将辅助技术提升到一个新的水平,减少应用开发时间,并赋予非技术用户强大的能力。

原本标题:Generative AI is here: How tools like ChatGPT could change your business

原文作者:Michael Chui、Roger Roberts、Lareina Yee

原文来源:麦肯锡

编译:DeFi 之道

生成式人工智能(AI)和其他基础模型正在改变AI的格局,将辅助技术提升到一个新的水平,减少应用开发时间,并赋予非技术用户强大的能力。

鉴于这篇文章的主题,我们问了 ChatGPT(一款可以根据用户提示词产出原创内容的生成型AI语言模型),这篇文章的开头应该如何写。以下是我们输入系统的提示词:

按照麦肯锡公司的风格,为一篇关于生成式AI将如何为企业带来变革的文章写一段开头。

ChatGPT 的回应:

生成式AI的兴起有可能成为企业运营的基本规律带来重大变革。这项技术基于对现有数据的学习,来生成原创内容,有彻底改变行业并改变公司运营方式的潜力。生成性AI使许多以前由人类完成的工作可以实现自动化,从而提高效率和生产力,降低成本,并开辟新的增长机会。因此,能够有效利用该技术的企业可能会获得显著的竞争优势。

这个回答并不完美,但令人印象深刻。

对于我们和我们最近接触的许多高管来说,在 OpenAI 开发的 ChatGPT 中输入一个提示词,就足以见证生成式AI的力量。在其发布之后的五天内,有超过一百万的用户登录该平台亲手体验。OpenAI 的服务器几乎无法满足需求,经常闪出信息提示用户在服务器容量释放出来后再来访问。

像ChatGPT和GitHub Copilot这样的产品,以及为这些系统提供动力的底层AI模型(例如Stable Diffusion、DALL-E 2、GPT-3),正在将技术带入曾经被认为是为人类保留的领域。有了生成式AI,计算机现在可以说是展现了创造力,可以根据查询产生原创内容,从获取的数据和与用户的互动中汲取营养。AI可以撰写博客、绘制包装设计草图、编写计算机代码,甚至对生产错误的原因进行理论分析。

这类最新的生成式AI系统建基于基础模型——一种大型深度学习模型,用涵盖多个主题的、大规模、广泛、非结构化的数据集(如文本和图像)训练而成。开发人员可以将这些模型应用于各种场景,而对每项任务几乎不需要进行微调。例如,ChatGPT的基础模型GPT-3.5也被用来翻译文本,科学家们使用GPT的早期版本创建了新的蛋白质序列。

上述能力可以为所有人所用,包括缺乏专业机器学习技能的开发者,在某些情况下,也包括没有技术背景的人。使用基础模型,还可以将开发新的AI应用的时间减少到前所未有的低水平。

生成式 AI 有望使 2023 年成为 AI 领域最激动人心的年份之一。但每一项新技术兴起之时,企业领导人都必须睁大双眼,生成式 AI 当下也带来了许多道德和实践层面的挑战。

向人类领域迈进

十多年前,我们曾写过一篇文章,将经济活动分为三类——生产、交易和互动,并考察了技术对每一个环节的影响程度。在100多年前的工业革命中,机器和工厂生产技术通过增强和自动化人类劳动改变了生产,而AI进一步提高了制造车间的效率。在大约相同的时期,交易也经历了许多技术迭代,包括数字化和自动化变革。

直到最近,互动性的工作,例如客户服务,还未经历过成熟的技术干预。生成式AI将改变这种状况,能以一种接近人类行为的方式从事互动性工作,在某些情况下,甚至难以察觉。不过,这并不是说这些工具是为了在没有人类输入和干预的情况下工作。许多情况下,这些工具与人类结合起来是最强大的,增强了他们的能力,使他们能够更快、更好地完成工作。

生成式AI也正在将技术推向一个被认为是专属于人类思维的领域:创造力。该技术利用其输入(所获得的数据和用户提示词)和经验(与用户的互动,帮助其 “学习”新信息和什么是正确/不正确)来生成全新的内容。

虽然在可预见的未来,人们在餐桌上将持续不断地争论AI生成的内容是否真的等同于创造力。但大多数人可能会同意,这些工具通过向人类提供初始的想法,将会向世界释放更多的创造力。

商业用途多多

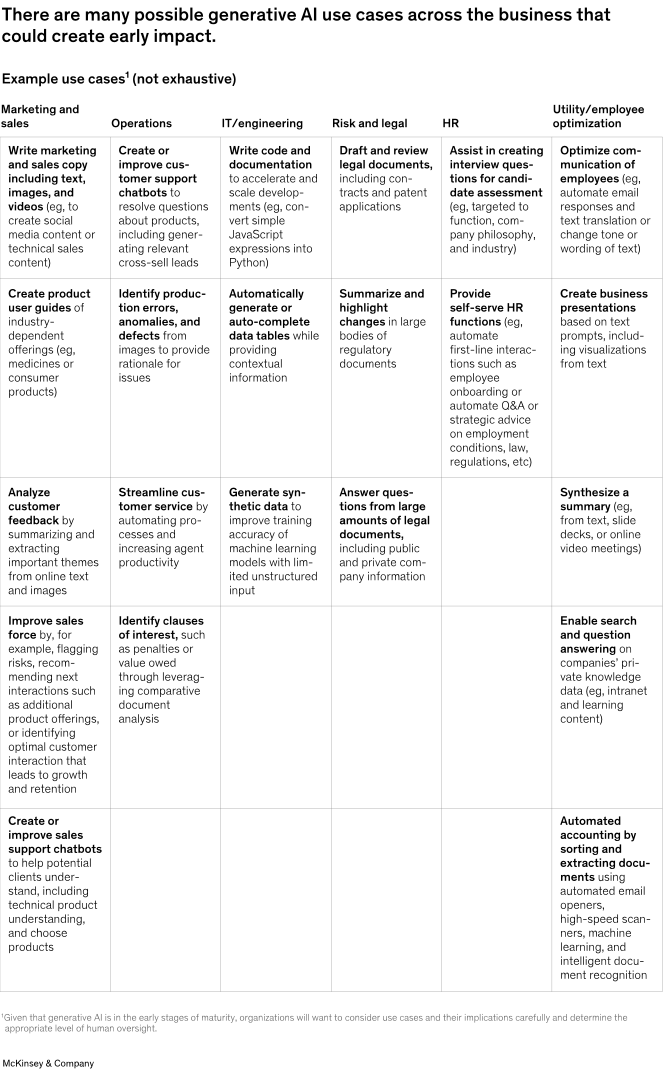

这些模型处于扩展的早期阶段,但我们已经开始看到第一批不同功能的应用,包括以下内容(参见图示):

- 营销和销售。起草个性化的营销、社交媒体和技术销售内容(包括文字、图像和视频);创建符合特定业务的助手,例如零售业。

- 操作。为有效执行特定活动而生成任务清单。

- IT/工程。编写、记录和审查代码。

- 风控和法律。从大量的法律文件中提取信息,回答复杂的问题,起草和审查年度报告。

- 研发。通过更好地了解疾病和发现化学结构,加速药物研发。

应该兴奋,但仍需要谨慎行事

由于生成式AI令人惊叹的产出结果,有人可能认为这是一种随时可以使用的技术,但事实并非如此。这种技术仍处在萌芽阶段,高管们必须谨慎行事。技术专家们仍在解决各种问题,大量的实践和道德问题仍未解决。

以下是其中几个问题:

- 像人类一样,生成式AI也会出错。例如,ChatGPT有时会产生“幻觉”,面对用户的问题,会自信地生成完全不准确的信息,并且没有内置的机制来提醒用户或质疑这个结果。例如,我们注意到,当要求ChatGPT创建一篇关于某个人的简历时,它生成了几个不正确的事实,比如列出了错误的学历。

- 过滤器还不能有效地捕捉到不恰当的内容。可以根据个人照片创建化身头像(avatar)的图片生成应用程序,其用户可能会从系统中收到裸体化身头像选项,尽管他们输入的是正常的照片。

- 系统性的偏见问题仍然需要解决。这些AI系统从大数据中提取信息,而来源数据中可能包含不应有的偏见。

- 不同公司的行为准则和价值观没有得到体现。公司需要对AI技术进行调整,才能纳入公司特有的文化和价值观,这已经超出了一些公司已有的技术专长和计算能力。

- 知识产权问题有待商榷。当一个生成式AI模型根据用户的提示词输出一个新的产品设计或想法时,谁能主张对结果的所有权?如果AI技术是抄袭了训练数据集中的某个来源,又该怎么办?

公司高管的初步行动

在考虑采用生成式AI技术的公司中,因为预计该技术将迅速发展,公司管理层希望迅速找出哪些业务部分该技术能产生最直接的影响,并实施相应的监测机制。为了不留遗憾,应该组建一个跨部门团队,成员包括数据科学从业者、法律专家和部分业务领导人,共同思考以下这些基本问题:

- 该技术可能在哪些方面帮助或颠覆我们的行业和/或我们企业的价值链?

- 我们的政策和立场是什么?例如,我们是在观望技术的发展,投资于试点项目,还是在寻求建立新的业务?各个业务领域对新技术的态度是否应该有所不同?

- 鉴于模型的局限性,我们有什么标准来选择合适的应用场景?

- 我们如何建立一个有效的生态系统,承载合作伙伴、社区和平台?

- 这些模式应该遵守哪些法律和社区标准,以便我们能够维护好利益相关者的信任?

同时,必须在整个组织内鼓励经过深思熟虑的创新,为大胆的尝试建立护栏和沙盒环境,其中许多已经可以通过云计算随时建立,还有更多可能即将出现。